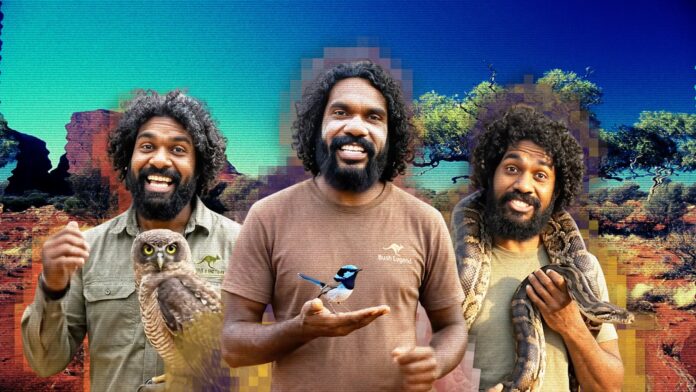

Uma personalidade viral do TikTok conhecida como “Bush Legend” – apresentando-se como um homem aborígene compartilhando fatos sobre animais nativos – é inteiramente gerada por IA, gerando debate sobre o “blackface digital” e o uso desenfreado de inteligência artificial para representar as culturas indígenas. A conta, ativa no TikTok, Facebook e Instagram, usa imagens criadas por IA de um homem em trajes tradicionais ao lado de música inspirada no didgeridoo, induzindo muitos espectadores a acreditarem que estão interagindo com conteúdo indígena autêntico.

A Ilusão de Autenticidade

O criador da conta afirma explicitamente que o conteúdo é gerado por IA na descrição do usuário, mas esse detalhe é facilmente ignorado por scrollers casuais. Muitos vídeos apresentam marcas d’água de IA ou legendas que reconhecem sua natureza sintética, mas uma parte significativa do público permanece inconsciente. A persona fabricada gerou reações positivas, com alguns comparando a “energia” da IA à de Steve Irwin. No entanto, este entusiasmo é dirigido a uma construção completamente artificial.

Falta de responsabilidade e respeito cultural

Este fenómeno realça uma tendência crescente: a IA é utilizada para simular povos, conhecimentos e culturas indígenas sem qualquer responsabilidade comunitária. Embora a conta em si não tenha danos diretos, ela contribui para um ambiente onde comentários racistas prosperam ao lado dela, com alguns usuários elogiando a personalidade da IA e, ao mesmo tempo, denegrindo indivíduos indígenas reais. O criador, radicado na Nova Zelândia, não tem qualquer ligação aparente com as comunidades aborígenes ou das ilhas do Estreito de Torres cuja semelhança está a ser explorada.

A resposta desdenhosa do criador – “Se isso não é o que você gosta, cara, apenas role e siga em frente” – falha em abordar as preocupações éticas subjacentes. A insistência em usar uma semelhança codificada pelos aborígenes para histórias genéricas de animais levanta questões sobre a intenção e reforça o problema da apropriação extrativista.

Propriedade cultural e intelectual indígena em risco

A IA generativa representa uma nova ameaça aos direitos de propriedade cultural e intelectual indígena (ICIP), expandindo-se para além da educação e da governação, para espaços digitais não regulamentados. A falta de envolvimento indígena na criação de IA e o custo ambiental da infra-estrutura de IA agravam ainda mais estas questões. O plano nacional de IA oferece pouca regulamentação significativa, deixando vulnerável a autodeterminação indígena.

A ascensão da IA “Blakface”

A facilidade com que a IA pode agora fabricar personas indígenas facilita uma nova forma de “AI Blakface” – representações superficiais e estereotipadas sem profundidade cultural. Estas figuras geradas pela IA muitas vezes usam jóias culturais ou simulam pintura ocre, apropriando-se de práticas sagradas sem compreensão ou respeito. Este colonialismo algorítmico dos colonos perpetua a violência digital contra os povos indígenas, permitindo que entidades não-indígenas lucrem financeiramente com o conhecimento roubado.

O que pode ser feito?

Aumentar a IA e a literacia mediática é essencial para distinguir o real do falso online. Apoiar criadores de conteúdo indígenas autênticos – como @Indigigrow, @littleredwrites ou @meissa – é crucial. Antes de interagir com conteúdo on-line, pergunte-se: Isso é gerado por IA? É para onde meu suporte deveria ir?

A utilização desenfreada da IA para simular culturas indígenas representa uma perigosa escalada de apropriação digital, diminuindo a autodeterminação e reforçando estereótipos prejudiciais. O envolvimento crítico e o apoio às vozes indígenas reais são vitais para contrariar esta tendência.