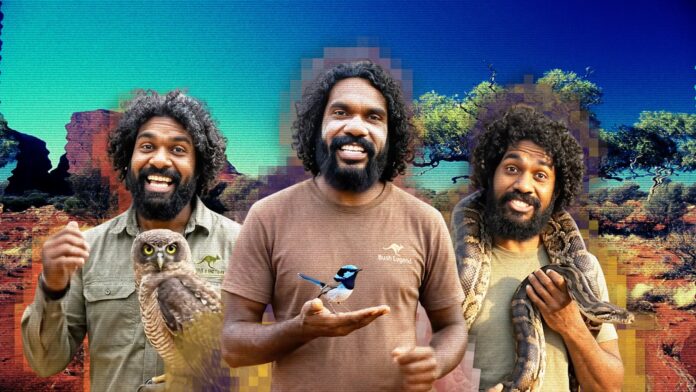

Okazało się, że wirusowy TikToker znany jako „Legenda Busha” udający Aborygena dzielącego się faktami na temat lokalnej fauny został w całości wygenerowany przez sztuczną inteligencję, co wywołało debatę na temat „cyfrowej czarnej twarzy” i niekontrolowanego wykorzystania sztucznej inteligencji do reprezentowania rdzennych kultur. Konto, aktywne na TikTok, Facebooku i Instagramie, wykorzystuje wygenerowane przez sztuczną inteligencję obrazy mężczyzn w tradycyjnych strojach z muzyką inspirowaną didgeridoo, wprowadzając wielu widzów w błąd, wierząc, że wchodzą w interakcję z autentycznymi treściami Aborygenów.

Iluzja autentyczności

Twórca konta wyraźnie stwierdza w opisie użytkownika, że treść jest generowana przez sztuczną inteligencję, ale zwykli użytkownicy łatwo przeoczą ten szczegół. Wiele filmów zawiera znaki wodne lub podpisy AI, które potwierdzają ich syntetyczny charakter, ale duża część widzów nie jest tego świadoma. Fikcyjna osobowość zebrała pozytywne recenzje, a niektórzy porównują „energię” sztucznej inteligencji do Steve’a Irwina. Zachwyt ten skierowany jest jednak na całkowicie sztuczny konstrukt.

Brak odpowiedzialności i szacunku dla kultury

Zjawisko to podkreśla rosnącą tendencję: wykorzystywanie sztucznej inteligencji do naśladowania rdzennej ludności, wiedzy i kultury bez ponoszenia odpowiedzialności przed społecznościami. Chociaż samo konto nie powoduje bezpośredniej szkody, przyczynia się do powstania środowiska, w którym kwitną rasistowskie komentarze, a niektórzy użytkownicy chwalą osobowość sztucznej inteligencji, dyskredytując prawdziwych rdzennych mieszkańców. Twórca z Nowej Zelandii nie ma widocznych powiązań z Aborygenami ani mieszkańcami wysp w Cieśninie Torresa, których zdjęcia są wykorzystywane.

Lekceważąca odpowiedź twórcy – „Jeśli ci się to nie podoba, kolego, po prostu przewiń dalej” – nie odnosi się do podstawowych kwestii etycznych. Naleganie na wykorzystanie obrazu zakodowanego jako aborygeński w ogólnych opowieściach o zwierzętach rodzi pytania dotyczące intencji i wzmacnia problem drapieżnego zawłaszczenia.

Własność kulturalna i intelektualna ludności tubylczej zagrożona

Generatywna sztuczna inteligencja stwarza nowe zagrożenie dla praw własności kulturalnej i intelektualnej rdzennych mieszkańców, wykraczające poza edukację i zarządzanie i obejmujące nieuregulowane przestrzenie cyfrowe. Brak udziału ludności tubylczej w tworzeniu sztucznej inteligencji oraz koszty środowiskowe infrastruktury sztucznej inteligencji pogłębiają te problemy. Krajowy program sztucznej inteligencji oferuje niewiele znaczących regulacji, co naraża rdzenną ludność na samostanowienie.

Powstanie sztucznej inteligencji „Blackface”

Łatwość, z jaką sztuczna inteligencja może obecnie tworzyć osobowości rdzennych mieszkańców, przyczynia się do powstania nowej formy „czarnej twarzy AI” – płytkich, stereotypowych przedstawień pozbawionych głębi kulturowej. Te postacie generowane przez sztuczną inteligencję często noszą kulturową biżuterię lub imitują ochrę, przywłaszczając sobie święte praktyki bez zrozumienia i szacunku. Ten algorytmiczny kolonializm utrwala przemoc cyfrową wobec ludności tubylczej, umożliwiając osobom nierodzimym czerpanie zysków finansowych ze skradzionej wiedzy.

Co można zrobić?

Zwiększanie umiejętności korzystania ze sztucznej inteligencji i korzystania z mediów jest niezbędne do odróżnienia prawdziwego i fałszywego Internetu. Wspieranie autentycznych rodzimych twórców treści, takich jak @Indigigrow, @littleredwrites lub @meissa, ma kluczowe znaczenie. Zanim wejdziesz w interakcję z treściami online, zadaj sobie pytanie: Czy ta sztuczna inteligencja została wygenerowana? Czy tutaj powinna znajdować się moja pomoc?

Niekontrolowane wykorzystywanie sztucznej inteligencji do naśladowania rdzennych kultur stanowi niebezpieczną eskalację zawłaszczenia cyfrowego, podważającą samostanowienie i wzmacniającą szkodliwe stereotypy. Krytyczne zaangażowanie i wsparcie dla prawdziwych głosów rdzennych mieszkańców jest niezbędne, aby przeciwdziałać tej tendencji.