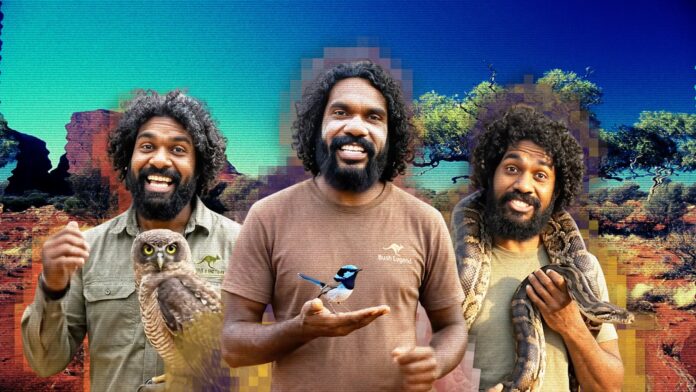

Una personalidad viral de TikTok conocida como “Bush Legend”, que se presenta como un hombre aborigen que comparte datos sobre animales nativos, está generada enteramente por IA, lo que genera un debate sobre la “cara negra digital” y el uso desenfrenado de inteligencia artificial para representar las culturas indígenas. La cuenta, activa en TikTok, Facebook e Instagram, utiliza imágenes creadas por IA de un hombre con atuendo tradicional junto con música inspirada en didgeridoo, lo que engaña a muchos espectadores haciéndoles creer que están interactuando con contenido indígena auténtico.

La ilusión de la autenticidad

El creador de la cuenta afirma explícitamente que el contenido está generado por IA en la descripción del usuario, pero los usuarios ocasionales pasan fácilmente por alto este detalle. Muchos vídeos presentan marcas de agua de IA o subtítulos que reconocen su naturaleza sintética, pero una parte importante de la audiencia sigue sin saberlo. La persona fabricada ha generado reacciones positivas, y algunos comparan la “energía” de la IA con la de Steve Irwin. Sin embargo, este entusiasmo se dirige a una construcción completamente artificial.

Falta de responsabilidad y respeto cultural

Este fenómeno pone de relieve una tendencia creciente: la IA se utiliza para simular pueblos, conocimientos y culturas indígenas sin ninguna responsabilidad comunitaria. Si bien la cuenta en sí carece de daño directo, contribuye a un entorno en el que los comentarios racistas prosperan junto a ella, con algunos usuarios elogiando a la personalidad de la IA y al mismo tiempo denigrando a individuos indígenas reales. El creador, radicado en Nueva Zelanda, no tiene ninguna conexión aparente con las comunidades aborígenes o isleñas del Estrecho de Torres cuyas imágenes se están explotando.

La respuesta desdeñosa del creador – “Si esto no es lo tuyo, amigo, simplemente desplázate y sigue adelante” – no aborda las preocupaciones éticas subyacentes. La insistencia en utilizar una semejanza codificada por los aborígenes para historias genéricas de animales plantea preguntas sobre la intención y refuerza el problema de la apropiación extractiva.

Propiedad cultural e intelectual indígena en riesgo

La IA generativa presenta una nueva amenaza para los derechos de Propiedad Cultural e Intelectual Indígena (ICIP), expandiéndose más allá de la educación y la gobernanza hacia espacios digitales no regulados. La falta de participación indígena en la creación de IA y el costo ambiental de la infraestructura de IA exacerban aún más estos problemas. El plan nacional de IA ofrece poca regulación significativa, lo que deja vulnerable la autodeterminación indígena.

El auge de la IA “Blakface”

La facilidad con la que la IA ahora puede fabricar personajes indígenas facilita una nueva forma de “AI Blakface”: representaciones superficiales y estereotipadas que carecen de profundidad cultural. Estas figuras generadas por IA a menudo usan joyas culturales o pintura ocre simulada, apropiándose de prácticas sagradas sin comprensión ni respeto. Este colonialismo algorítmico de colonos perpetúa la violencia digital contra los pueblos indígenas, permitiendo que entidades no indígenas se beneficien financieramente del conocimiento robado.

¿Qué se puede hacer?

Aumentar la inteligencia artificial y la alfabetización mediática es esencial para distinguir lo real de lo falso en línea. Apoyar a los auténticos creadores de contenido indígena, como @Indigigrow, @littleredwrites o @meissa, es crucial. Antes de interactuar con contenido en línea, pregúntese: ¿Esto está generado por IA? ¿Es aquí donde debería ir mi apoyo?

El uso desenfrenado de la IA para simular culturas indígenas representa una peligrosa escalada de apropiación digital, que disminuye la autodeterminación y refuerza estereotipos dañinos. El compromiso crítico y el apoyo a las voces indígenas reales son vitales para contrarrestar esta tendencia.